2. 浙江大学医学院附属第二医院临床医学工程部,杭州 310009;

3. 浙江大学医学院附属第二医院急诊科,杭州 310009;

4. 浙江大学信息与电子工程学院,杭州 310027

重症医学科(intensive care unit, ICU)收治了大量器官或系统功能障碍的患者,接受插管等有创操作会使患者不适,可能会发生患者躁动、谵妄等,从而影响治疗过程[1]。躁动指患者因意识障碍加重引起的精神和运动兴奋的一过性状态,发生在麻醉恢复后或疼痛加重时,常表现为高度烦躁、肢体不规则运动等[2]。研究表明,麻醉恢复期躁动发生率2.09%[3],而躁动患者相较于普通患者更容易发生跌倒坠床、非计划拔管、约束部位皮肤损伤等不良事件[4-6],严重影响患者治疗及预后。躁动发生伴有心率增快、血压升高等不良体征[7],主要诱因为脑细胞功能受损、缺氧或缺血等。躁动发生原因难以控制,及时发现和干预躁动行为是避免不良事件的重要途径,因而对ICU患者的躁动识别监测至关重要。ICU躁动监测主要依靠量表人为评分,结果具有主观性,同时由于ICU的工作强度,仅依靠人力较难实现对患者躁动的及时、全面监测及预警[8]。目前对躁动预警的研究仅见于通过多因素分析构建风险预测模型[2, 9],尚未实现躁动预警实时监测系统的研制。

目前ICU已通过电生理实现对患者生命体征的实时监测及异常报警,国外有研究通过面部识别技术实时识别患者疼痛[10-11],但未有ICU患者躁动行为实时监测研究。随着5G技术与图像处理技术的发展,视频摄像头已能对肢体动作、面部表情进行分析识别[12],通过对人体动态特征点跟踪采样构建人体动作的三维图像采集模型[13],变换检测被广泛应用于生命体征信号检测领域[14],这些技术使构建躁动患者的全面监测模型成为可能。本研究构建重症患者躁动监测报警系统模型,通过对患者肢体活动的连续监测,对躁动早期倾向性行为进行预警,进一步保障监护室患者安全。

1 资料与方法 1.1 团队构建构建躁动患者监测报警系统多学科团队。具备模型构建与识别能力的信电专业正高职称教授1名,负责模型构建布局、数据预处理、模型训练;信电博士研究生2名,负责协助模型构建及训练;具有10年以上工作经验的副高级职称护理管理者1名,负责团队协调、问题沟通;护理研究生3名,负责躁动数据资料的收集;具有中深度镇静资质的急诊ICU医生、护理工作者3名,负责视频数据的分类;信息工程师2名,负责躁动监测装置的实现。

1.2 研究对象与研究工具本研究的研究对象为收治在急诊监护室的重症患者。纳入标准:(1)应用镇静药物的患者;(2)气管插管或气管切开的患者;(3)接受保护性约束的患者;(4)留置胃管或尿管等其他有创管道的患者。排除标准:(1)高位截瘫的患者;(2)确诊脑死亡的患者;(3)GCS评分3分;(4)由于疾病或治疗原因如肢体不健全、截肢患者等无法对肢体活动进行观察的患者;(5)由于疾病或治疗因素如颌面部外伤、烧伤、肿瘤、手术等无法观察面部表情的患者;(6)拒绝参加本研究的患者。

本研究选用Richmond躁动-镇静评分(Richmond agitation-sedation scale, RASS)评分对患者的躁动行为进行分类。在早期数据处理时将收集好的图像视频数据通过医护共同评估后,将RASS评分处于“+2~+4分”的患者纳入躁动组,评分为“-5~+1分”的患者纳入非躁动组,以参与数据模型构建。

1.3 数据收集与分类建立视频库及视频分类表单。3名护理硕士研究生负责前期视频数据的收集。通过科室每个床位对应天花板上方安装固定好的摄像头实现对患者的实时监控,并可实现后台自动备份,数据收集人员通过逐帧查看视频资料截取出存在明显躁动或非躁动特征行为的视频,编码后保存到硬盘内。由2名具有监护室工作经验的医生和护士依据RASS评分表对视频中患者的躁动或非躁动行为进行独立分类,分类结果一致的直接录入《视频分类信息表》中,不一致者由第三名具有监护室工作经验的医生决定。视频收集过程中注意对患者隐私部位的遮挡和保护。对视频编码分类的研究员均具有中深度镇静资质,参与研究的所有患者或家属均知情同意并签字。本研究的摄像头位于每个病床天花板上方,定时调整摄像头的位置以保证对患者的有效监控。本研究以通过查看回放的形式截取5~10 s的视频片段,不存在实时的患者安全问题。本科室安装的摄像头是为患者家属提供探视使用,摄像头之间高度统一,只能捕获目标床位的影像。

1.4 模型构建由1名信电专业教授和2名博士研究生进行躁动预警系统模型构建。对于输入的监护室视频流,模型采用变换检测与人体表面映射相结合的方法,对视频中的重症患者进行行为识别。通过变换检测,模型可以根据视频中的变化情况来判断患者是否处于躁动状态,并通过变化的幅度进一步评估躁动的程度,从而实现及时有效的预警[15]。同时,通过建立2D图像平面到3D人体标准模型的表面映射,模型能够学习到三维人体的先验知识与形状特征[16],从而更细致地理解患者在空间中的动作,判断其是否处于躁动状态,并实现对躁动程度的精准评估。

模型包含两个主要分支,分别是变换检测分支与表面映射分支,变换检测分支逐帧输出空间变化特征,表面映射分支逐帧输出表面嵌入特征[17]。通过将两个分支输出特征进行空间级别上的多模态融合,并将融合后的特征输入时间卷积神经网络,进一步提取时序特征,可以得到鲁棒且具有高度可判别性的人体行为特征[18]。最后,利用躁动行为分类器对人体行为特征进行躁动等级分类,以实现对视频中患者躁动行为的全面评估。

1.4.1 变换检测分支该分支采用密集型任务预训练的大模型作为帧级别的特征提取器[19]。依托冻结的大模型特征提取器输出的单帧特征,可以实现像素级别的变化检测,利用相似度度量函数实现对相邻帧之间变化区域的定位,并输出帧级变换特征图[20]。这使得模型能够快速而精确地获得初步的变化检测结果,从而在视频流中确定可能的躁动行为。

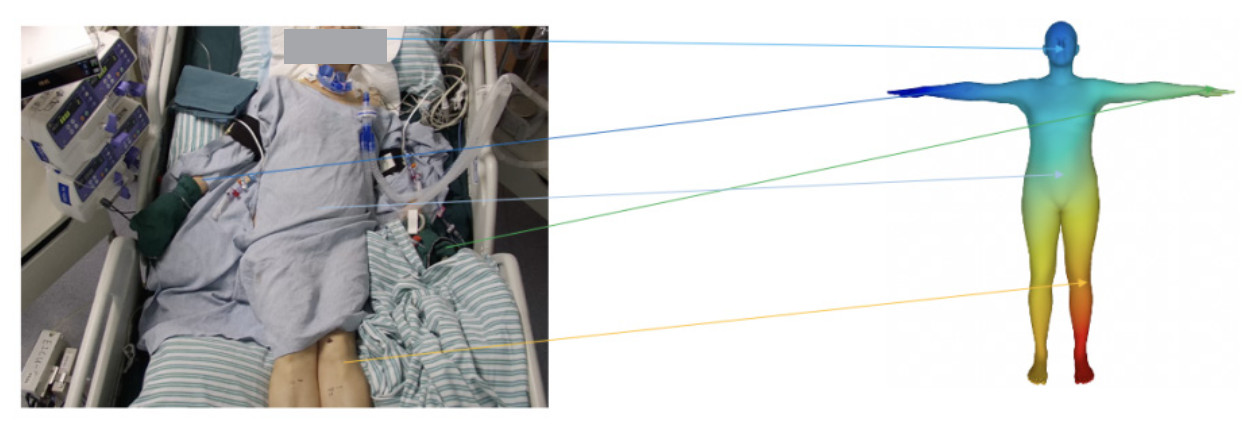

1.4.2 表面映射分支该分支使用基于UNet的嵌入模块对视频进行逐帧编码,对于落在人体内部的每一个像素点,嵌入模块将其编码为高维特征向量,并约束该特征向量与人体标准模型顶点的点云编码特征进行对齐。由于嵌入模块采用基于UNet的网络结构,因此编码得到的表面嵌入特征图保留了原输入帧的空间分辨率,并且为每个位置的像素点显式的学习到了其对应于三维人体标准模型的哪个顶点,从而赋予了其丰富的语义信息。嵌入模块输出的表面嵌入特征蕴含了丰富的三维人体的先验知识与形状特征,可以使模型更好的理解三维空间中的人体动作变化,从而判断患者是否发生躁动以及躁动幅度大小。见图 1。

|

| 图 1 2D图像平面到3D人体标准模型的表面映射 |

|

|

模型首先利用卷积神经网络将表面映射分支输出的表面嵌入特征图编码,进一步增强模型对3D形状的感知,同时对其进行下采样,使之与变换检测分支输出的帧级变换特征图具有相同大小的分辨率。而后,模型通过交叉注意力机制对帧级变换特征图与表面嵌入特征图进行空间级别的融合,并将融合得到的特征输入时间卷积神经网络中进一步提取时序特征,得到鲁棒且具有高度判别性的人体行为特征。最后,模型利用可训练的预测头对人体行为特征进行躁动等级分类,输出患者的躁动状态(0代表非躁动状态,1代表躁动状态)。最终将进一步转化为声音信号对躁动状态的行为进行报警。

1.5 研究过程中的伦理问题本研究已获得浙江大学医学院附属第二医院人体研究伦理委员会的批准[伦理审批号:(2024)伦审研第(0135)号],所有参与本研究的患者及家属均知情同意并参与签署知情同意书。(1)本研究需要采集及分析患者的声像资料,声像资料会转换成3D模型实施行为模拟,在此过程中不会造成任何风险以及隐私信息泄露,尤其是不会暴露患者面部特征与隐私部位。(2)本研究为观察性研究,不涉及干预及随访,不会产生不良反应及风险。本研究确保各项临床数据及声像资料均会进行隐私保护处理。除研究者、伦理委员会、监查、稽查、药政管理部门等相关人员将被允许查阅外,其他与研究无关的人员无权查阅医疗记录。(3)有关受试者身份的所有记录均予以保密,所有视频声像资料均予以保密,并且在相关法律和(或)法规允许的范围之外这些资料不对外公开,与合作单位签订保密协议,所有患者的音视频资料均采用加密方式进行保护,确保不用于本次研究以外的任何目的。

2 结果 2.1 视频数据收集分类结果共采集到482例重症患者的3 802个监护视频片段,其中躁动视频片段1 703个,非躁动视频片段2 099个。全部视频片段的帧率为25 fps(每秒25帧),分辨率为4K(3 840×2 160),长度均严格约束为2 s。按照7∶1∶2的比例,将采集得到的监护视频片段划分为训练集、验证集与测试集,得到训练集、验证集的躁动视频数量分别为1 193个、170个、340个,非躁动视频数量分别为1 470个、209个、420个。

2.2 重症患者躁动检测建模结果本研究使用单张型号为RTX 3090TI的GPU在训练集上进行训练,当模型在验证集上的性能表现不再提高后,训练过程自动停止。训练后的模型在测试集上的躁动分类表现出色,能够准确识别监护室中的重症患者是否发生躁动。模型的性能指标,包括躁动识别的准确率以及RASS评分的预测准确率。

如表 1所示,针对躁动识别任务,模型在验证集上收敛时的准确率为97.1%,而在训练集上的成功率达到99.0%。经过训练后的模型在测试集上进行评估时,取得了98.5%的准确率。模型在测试集上的准确率达到98.5%,表明模型在识别视频中躁动行为方面非常可靠,能够有效地从监护视频数据中提取关键特征,并判定重症患者是否处于躁动状态。此外,由于在数据处理过程中,RASS评分处于“+2~+4分”的视频被纳入躁动组,而评分为“-5~+1分”的视频被纳入非躁动组,因此,躁动识别的准确率与模型感知RASS评分大致范围的能力具有很强的正相关性。躁动识别的高准确率表明模型对于视频中患者RASS评分的大致范围具有较好的感知能力。

| 数据集类别 | 躁动识别准确率(%) | RASS评分准确率(%) |

| 训练集 | 99.0 | 91.8 |

| 验证集 | 97.1 | 88.1 |

| 测试集 | 98.5 | 90.3 |

从表 1可以看出,针对RASS评分的多分类,模型在验证集上的收敛准确率为88.1%,收敛时训练集上的准确率达到了91.8%。模型在测试集上评估时,对于患者RASS评分的预测准确率为90.3%,表明模型对于更细粒度的患者镇静程度分类同样具有较好的表现,但相比于躁动识别的二分类,其准确率有所下降。原因是两方面的:其一,与躁动识别的二分类相比,对于RASS评分的多分类涉及更多的细微差别和复杂情况,因此训练模型使其准确捕捉和区分更细致的变化是更具挑战性的;其二,RASS评分的打分具有较强的主观性,医护人员的个人经验、偏好和主观判断可能会影响对患者镇静程度的评估,评分的主观性会对模型的训练造成一定影响。

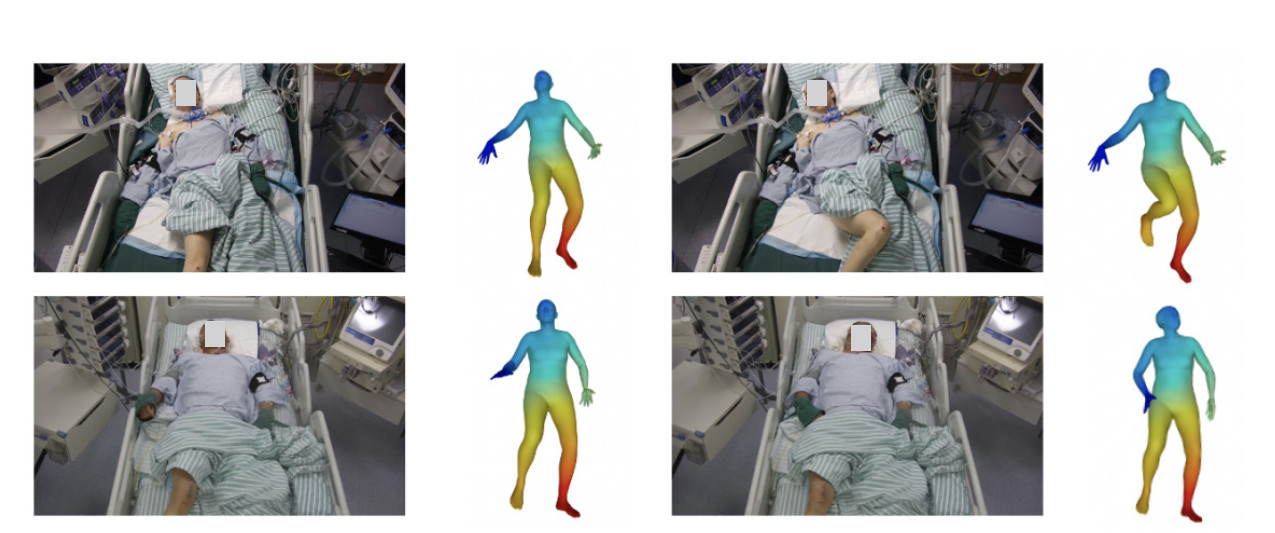

以上结果表明,模型在监护室测试视频上展现了出色的判别能力和稳健性,为监护室环境中患者躁动行为的自动检测提供了有效的解决方案,具有较强的实际应用价值。此外,本研究对表面嵌入特征的可靠性进行了可视化评估,图 2展示了利用表面映射驱动人体三维模型变形得到的三维建模结果。

|

| 图 2 三维人体建模可视化结果 |

|

|

通过可视化结果可以看出,模型学习的2D图像平面到3D人体标准模型的对应关系是高度可靠的,表面嵌入特征能够很好的引导模型进行网格变形,从而达到精细准确的人体三维模型效果。因此,在实际应用中,医护工作者可以实时的观察三维空间中人体建模的可视化效果来判断监护室内的重症患者是否发生了躁动。

3 讨论重症患者躁动监测报警模型有助于监护室患者安全,躁动会导致患者坠床、非计划拔管、手术切口裂开等问题[21],给临床工作带来一系列安全隐患和护理困难[9]。研究表明,苏醒期躁动是麻醉恢复期常见的并发症之一,在成人全麻手术中的发生率高达19%[22],表现为兴奋、躁动、定向障碍和无意识的肢体活动等[23],易造成意外伤害并严重影响患者术后康复。躁动的原因通常与手术、麻醉、插管等有创操作有关,这些因素不可避免,因此躁动的早期预警和干预是临床护理工作中监测患者安全的关键。目前监护室对于躁动危险行为识别主要靠人员识别,这就无法满足躁动行为的及时动态监测与早期危险躁动行为的识别。而构建智能化的躁动监测预警系统有利于实现对躁动的持续监测,及躁动发生后的及早干预,可减少躁动引起的不良事件,对临床工作和患者预后均有重要意义。本研究是对监护室患者躁动行为建立报警模型实现全面监控的初步尝试,模型在测试中呈现出98.5%的躁动识别准确率,90.3%的RASS评分准确率,表明在躁动的样本中模型的非误判效果较高[24],这为该模型在临床过程中的应用增加了信心。

重症患者躁动监测报警模型构建过程具有一定的科学性。首先,模型构建过程严谨。本研究构建的多学科团队涉及临床工作者、信息技术与电子工程专业、工程师等,且成员具有一定的资质,多学科成员实时线上线下联动,充分发挥了多学科团队的优势[25]。本研究在数据收集和分类过程中进行严格的质量控制,双人独立对视频进行分类,意见不一致者由向第三者介入,而且研究人员均具有重症监护室工作经验,这些均保证了后期建模结果的有效性。多学科团队在整个研究过程中多次线上线下讨论,头脑风暴确定合理的视频分类方法、探讨合适的模型构建方法,保证团队工作协调一致,有效解决建模过程中遇到的问题,保证模型构建顺利进行。其次,本研究研究工具的选择较为严谨。目前临床上关于躁动评估的量表有Ramsay镇静评分(Ramsay sedation scale, RSS)、Riker镇静-躁动评分(Riker sedation-agitation scale, SAS)。其中,本研究选择了在全球广泛应用且得到美国重症医学会[26]推荐的RASS评分量表保证了模型构建结果的准确性。同时,本研究面临一定的困难,为确保模型构建结果更加精准,要求更大数量的样本量纳入模型训练,为前期数据集的采集和分类工作增加了一定的工作量,后续将尝试多中心的数据收集工作。

本研究通过多学科团队构建的重症患者躁动报警模型具有一定的临床应用价值,该模型预期可实现对重症患者躁动行为的持续监测,并对躁动行为实时报警。下一步将尝试更大样本的数据收集对模型进一步优化,并将试把模型算法置入摄像头中完成躁动监测预警装置,在临床进行初步应用,检验模型的实际应用预测效果偏倚,并结合医护人员的工作体验对模型进一步调试,实现为重症患者躁动行为的持续监测预警。

利益冲突 所有作者声明无利益冲突

作者贡献声明 黄晓霞、许永安:研究设计、论文撰写与修改;褚永华、叶建平:数据收集及整理;王育斌、金军灿、于慧敏:模型构建、论文方法学撰写及修改;高梦珂:论文撰写;唐佳迎、梁景程:数据处理、论文修改

| [1] | 仰珍蕾. 对接受机械通气的ICU患者实施护士主导的镇痛镇静管理的效果分析[J]. 当代医药论丛, 2018, 16(23): 247-248. DOI:10.3969/j.issn.2095-7629.2018.23.180 |

| [2] | 郭先才, 李佳雨, 周汉京, 等. 全身麻醉病人术后苏醒期躁动风险预测模型的建立及应用[J]. 护理研究, 2021, 35(11): 2038-2041. DOI:10.12102/j.issn.1009-6493.2021.11.036 |

| [3] | Xie CM, Yao YT. Anesthesia management for pediatrics with congenital heart diseases who undergo cardiac catheterization in China[J]. J Interv Cardiol, 2021, 2021: 8861461. DOI:10.1155/2021/8861461 |

| [4] | 陈丽娟. 人性化保护性约束护理在ICU清醒躁动患者中的应用[J]. 护理实践与研究, 2020, 17(23): 144-146. DOI:10.3969/j.issn.1672-9676.2020.23.052 |

| [5] | 纪媛媛, 王军, 俞洁, 等. 神经外科ICU患者身体约束分级管理方案的构建及应用[J]. 中华护理杂志, 2021, 56(3): 342-346. DOI:10.3761/j.issn.0254-1769.2021.03.004 |

| [6] | Minda Z, Samuel H, Aweke S, et al. Magnitude and associated factors of unplanned extubation in intensive care unit: a multi-center prospective observational study[J]. Ann Med Surg, 2022, 79: 103936. DOI:10.1016/j.amsu.2022.103936 |

| [7] | Heily M, Gerdtz M, Jarden RJ, et al. Agitation during anaesthetic emergence: an observational study of adult cardiac surgery patients in two Australian intensive care units[J]. Aust Crit Care, 2024, 37(1): 67-73. DOI:10.1016/j.aucc.2023.09.003 |

| [8] | Nerella S, Cupka J, Ruppert M, et al. Pain action unit detection in critically ill patients[J]. Proc COMPSAC, 2021, 2021: 645-651. DOI:10.1109/compsac51774.2021.00094 |

| [9] | 张硕, 王施杭, 王越, 等. 全麻苏醒期患儿躁动风险预测模型的建立与验证[J]. 护理学杂志, 2023, 38(11): 1-4. DOI:10.3870/j.issn.1001-4152.2023.11.001 |

| [10] | Dawes TR, Eden-Green B, Rosten C, et al. Objectively measuring pain using facial expression: is the technology finally ready?[J]. Pain Manag, 2018, 8(2): 105-113. DOI:10.2217/pmt-2017-0049 |

| [11] | Walter S, Al-Hamadi A, Gruss S, et al. Multimodal recognition of pain intensity and pain modality with machine learning[J]. Schmerz, 2020, 34(5): 400-409. DOI:10.1007/s00482-020-00468-8 |

| [12] | 黄晓霞, 李瑶, 陈昊天, 等. 结合5G和人工智能技术构建新一代智慧化ICU单元的探索[J]. 中华急诊医学杂志, 2021, 30(10): 1269-1273. DOI:10.3760/cma.j.issn.1671-0282.2021.10.021 |

| [13] | 孙桂煌. 基于机器学习的人体动作深度信息识别方法研究[J]. 佳木斯大学学报(自然科学版), 2020, 38(1): 37-40. DOI:10.3969/j.issn.1008-1402.2020.01.009 |

| [14] | 罗琪. 以深度学习方法为载体的医学影像实时变化检测算法分析[J]. 粘接, 2020, 44(12): 132-135. DOI:10.3969/j.issn.1001-5922.2020.12.034 |

| [15] | Ianina A, Sarafianos N, Xu YL, et al. BodyMap: learning full-body dense correspondence map[C]//2022 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). June 18-24, 2022, New Orleans, LA, USA. IEEE, 2022: 13276-13285. DOI: 10.1109/CVPR52688.2022.01293. |

| [16] | Wang QZ, Qian XL, Li B, et al. Exploring fine-grained representation and recomposition for cloth-changing person re-identification[C]//IEEE Transactions on Information Forensics and Security. June 14, 2024, IEEE, 2024: 6280-6292. DOI: 10.1109/TIFS.2024.3414667. |

| [17] | Loper M, Mahmood N, Romero J, et al. SMPL: a skinned multi-person linear model[J]. Acm Transactions on Graphics, 2015, 34(6cd): 248. DOI:10.1145/2816795.2818013 |

| [18] | Haugaard RL, Buch AG. SurfEmb: dense and continuous correspondence distributions for object pose estimation with learnt surface embeddings[C]//2022 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). June 18-24, 2022, New Orleans, LA, USA. IEEE, 2022: 6739-6748. DOI: 10.1109/CVPR52688.2022.00663. |

| [19] | Tan FT, Tang DH, Dou MS, et al. HumanGPS: geodesic PreServing feature for dense human correspondences[C]//2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). June 20-25, 2021, Nashville, TN, USA. IEEE, 2021: 1820-1830. DOI: 10.1109/CVPR46437.2021.00186. |

| [20] | Güler RA, Neverova N, Kokkinos I. DensePose: dense human pose estimation in the wild[C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. June 18-23, 2018, Salt Lake City, UT, USA. IEEE, 2018: 7297-7306. DOI: 10.1109/CVPR.2018.00762. |

| [21] | 何若飞, 黄惠桥, 卢舒雨, 等. 全身麻醉患儿术后苏醒期躁动影响因素的Meta分析[J]. 检验医学与临床, 2023, 20(3): 349-352. DOI:10.3969/j.issn.1672-9455.2023.03.014 |

| [22] | 冯昭妍, 张松, 俞卫锋. 成人全麻后苏醒期躁动的研究进展[J]. 临床麻醉学杂志, 2021, 37(7): 769-772. DOI:10.12089/jca.2021.07.022 |

| [23] | Card E, Pandharipande P, Tomes C, et al. Emergence from general anaesthesia and evolution of delirium signs in the post-anaesthesia care unit[J]. Br J Anaesth, 2015, 115(3): 411-417. DOI:10.1093/bja/aeu442 |

| [24] | 刘元杰, 安雯, 林建涵, 等. 面向非规范化数据源的动物体温异常识别方法[J]. 农业机械学报, 2023, 54(11): 295-305. DOI:10.6041/j.issn.1000-1298.2023.11.029 |

| [25] | 姚自强, 秦宁, 石双姣, 等. 数字健康技术在高血压患者药物管理中的应用进展[J]. 中华护理杂志, 2023, 58(11): 1403-1409. DOI:10.3761/j.issn.0254-1769.2023.11.019 |

| [26] | 周林, 何亚伦, 曹梅利. ICU患者疼痛、躁动、谵妄护理管理评估与策略及实施现状[J]. 中国护理管理, 2019, 19(3): 444-448. DOI:10.3969/j.issn.1672-1756.2019.03.025 |

2024, Vol. 33

2024, Vol. 33